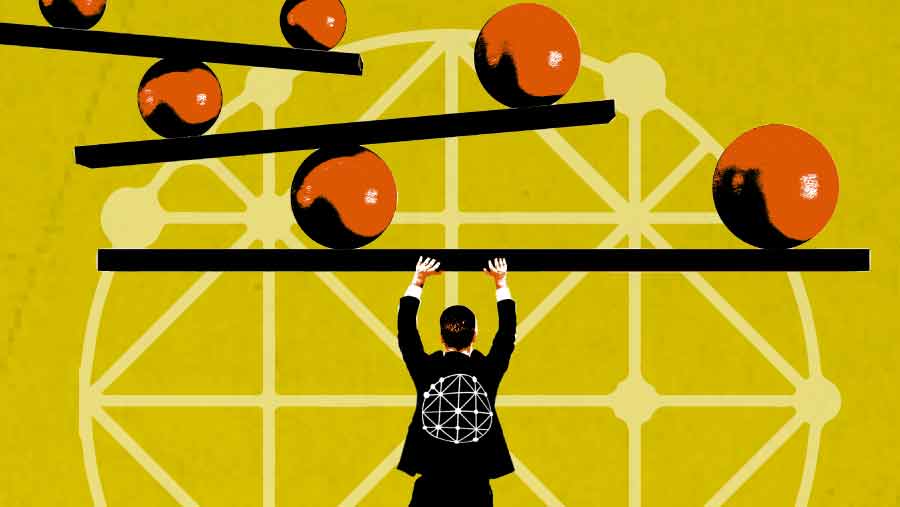

“Peretas menyamarkan input memanipulasi sistem AI generative (GenAI) untuk membocorkan data sensitive, menyebarkan informasi yang menyesatkan, atau yang lebih buruk lagi,” tulis IBM, dikutip Rabu (13/5/2026).

Prompt injection selanjutnya dapat membuat sistem AI generatif membocorkan data sensitif, menyebarkan misinformasi, hingga menjalankan perintah yang tidak semestinya. Hal itu terjadi karena pelaku memanfaatkan kelemahan mendasar pada model AI yang memproses instruksi pengembang dan input pengguna dalam format bahasa alami yang sama.

Cara kerja serangan prompt injection

Pada praktiknya, peretas dapat menyusun perintah tertentu agar terlihat seperti input biasa. Namun, instruksi tersebut sebenarnya dirancang untuk mengesampingkan aturan yang dibuat pengembang dan memaksa AI mengikuti perintah penyerang.

Kerentanan prompt injection muncul karena sistem prompt dan input pengguna sama-sama berbentuk teks bahasa alami. AI tidak memiliki mekanisme bawaan untuk membedakan mana instruksi resmi dari pengembang dan mana perintah yang berasal dari pengguna.

Akibatnya, jika penyerang membuat input yang cukup menyerupai instruksi sistem maka AI dapat mengabaikan aturan awal dan menjalankan perintah baru yang dimasukkan penyerang.

Pada banyak kasus model AI lebih mengandalkan pola bahasa dan konteks yang dipelajari selama pelatihan dibanding identifikasi teknis terhadap sumber instruksi.

IBM mencontohkan kasus ketika mahasiswa Stanford, Kevin Liu, berhasil membuat Bing Chat mengungkap instruksi internalnya melalui manipulasi prompt. IBM menyebut mekanisme kerja serangan ini mirip dengan SQL injection pada sistem basis data. Namun prompt injection menyerang model bahasa AI. Bedanya, prompt injection tidak menggunakan kode berbahaya, melainkan bahasa natural untuk memanipulasi perilaku AI.

Menurut IBM, kerentanan ini muncul karena model AI sulit membedakan mana instruksi resmi dari pengembang dan mana input biasa dari pengguna. Semua teks diproses sebagai satu rangkaian perintah. Jika penyerang membuat input yang menyerupai instruksi sistem, AI dapat mengabaikan aturan awal dan mengikuti perintah penyerang.

Jenis prompt injection

Prompt injection secara umum terbagi menjadi dua jenis utama, yakni direct prompt injection dan indirect prompt injection. Pada metode langsung, penyerang memasukkan instruksi berbahaya langsung ke chatbot atau aplikasi AI. Sedangkan pada metode tidak langsung, instruksi disisipkan ke sumber eksternal seperti situs web, dokumen, email, atau gambar yang kemudian diproses AI.

Dalam skenario indirect prompt injection, IBM mencontohkan penyerang dapat menanam instruksi tersembunyi di forum internet agar AI yang merangkum halaman tersebut mengarahkan pengguna ke situs phishing. Instruksi berbahaya bahkan dapat disisipkan dalam gambar yang dipindai AI.

“Prompt berbahaya tidak harus ditulis dalam teks biasa. Mereka juga disematkan dalam gambar yang dipindai LLM.”

Berbeda dengan jailbreaking

IBM menyatakan prompt injection berbeda dengan jailbreaking. Jika prompt injection bertujuan menyisipkan instruksi tersembunyi agar AI menjalankan tindakan tertentu, sementara jailbreaking membuat AI mengabaikan pembatasan atau guardrails yang dipasang pengembang.

Injeksi prompt dapat digunakan untuk melakukan jailbreak pada LLM dan taktik jailbreak dapat membuka jalan untuk keberhasilan injeksi prompt, tetapi pada akhirnya keduanya merupakan dua teknik yang berbeda.

Perusahaan teknologi itu menilai prompt injection menjadi salah satu tantangan keamanan terbesar dalam pengembangan AI generatif. Bahkan, IBM menyebut kerentanan ini menempati posisi pertama dalam daftar risiko keamanan aplikasi LLM versi OWASP Top 10.

Risiko prompt injection

IBM menyebut, belum ada metode yang benar-benar mampu menghilangkan risiko prompt injection. Pembatasan input dan output AI dinilai dapat mengurangi fleksibilitas model bahasa besar yang memang dirancang untuk memahami berbagai instruksi bahasa alami.

Injeksi prompt tidak memerlukan banyak pengetahuan teknis. Dengan cara yang sama sebagaimana LLM dapat diprogram dengan instruksi bahasa alami, LLM juga dapat diretas dalam bahasa Inggris biasa.

Hal yang perlu dicatat, injeksi prompt tidak mesti illegal tetapi hanya jika digunakan untuk tujuan terlarang. Banyak pengguna dan peneliti yang sah menggunakan teknik injeksi prompt untuk lebih memahami kemampuan LLM dan celah keamanan.

Dalam praktiknya, peretas menyisipkan instruksi tertentu agar AI menjalankan tindakan yang tidak semestinya. Berikut sejumlah risiko yang dapat muncul akibat prompt injection:

Kebocoran prompt

Peretas dapat mengelabui LLM untuk membocorkan system prompt atau instruksi internal yang digunakan developer. Meski tidak selalu berisi data sensitif, instruksi tersebut dapat dimanfaatkan pelaku kejahatan sebagai template untuk menyusun serangan baru. Jika input penyerang cukup menyerupai instruksi sistem, AI cenderung mengikuti perintah tersebut.

Eksekusi kode jarak jauh

Jika aplikasi AI terhubung dengan plugin atau sistem yang dapat menjalankan kode, prompt injection dapat digunakan untuk memerintahkan AI menjalankan program berbahaya. Kondisi ini berpotensi membuka akses tidak sah ke sistem yang terkoneksi dengan AI.

Pencurian data

Peretas juga dapat memanipulasi chatbot atau asisten virtual agar membocorkan informasi pribadi pengguna. Dalam layanan pelanggan berbasis AI, misalnya, chatbot dapat diarahkan untuk mengeluarkan detail akun atau data sensitif lainnya melalui instruksi tertentu.

Kampanye informasi menyesatkan

Integrasi chatbot AI dengan mesin pencari membuka risiko penyebaran informasi menyesatkan. Pelaku kejahatan dapat menyisipkan prompt tersembunyi di situs web agar AI menampilkan jawaban tertentu secara positif.

Transmisi malware

Peneliti juga menemukan potensi penyebaran malware melalui prompt injection. Dalam skenario yang diuji, peretas mengirim prompt berbahaya lewat email korban. Ketika email tersebut diringkas oleh asisten AI, instruksi tersembunyi dapat mengelabui AI untuk mengirim data sensitif kepada penyerang. Prompt tersebut bahkan dapat memerintahkan AI meneruskan instruksi berbahaya ke kontak lain secara otomatis.

(mef/wep)