Distilasi adalah teknik di mana “mentor” model AI yang lebih tua digunakan untuk melatih model “anak” baru. Caranya, mereplikasi kemampuan sistem sebelumnya — seringkali dengan biaya jauh lebih rendah dibandingkan membuat model AI lama.

Beberapa bentuk distilasi diterima secara luas dan bahkan didorong oleh laboratorium AI, seperti saat perusahaan membuat versi lebih kecil dan efisien dibandingkan model AI mereka sendiri, atau mengizinkan developer di luar menggunakan distilasi untuk membangun teknologi non-kompetitif.

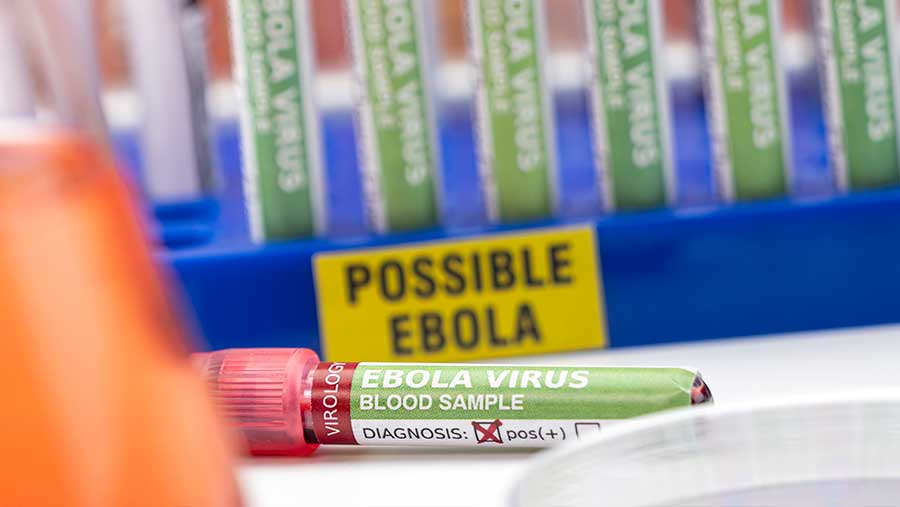

Meski begitu, distilasi menjadi kontroversial saat digunakan oleh pihak ketiga — terutama di negara-negara musuh seperti China atau Rusia — tujuannya meniru karya eksklusif tanpa izin. Laboratorium AI terkemuka di AS telah memperingatkan bahwa negara asing berstatus musuh dapat menggunakan teknik ini untuk mengembangkan model AI yang dilucuti dari pengaman keselamatan, seperti batasan yang akan mencegah pengguna menciptakan patogen mematikan.

Sebagian besar model yang dibuat oleh laboratorium-laboratorium China bersifat open weight, berarti,bahwa bagian-bagian dari sistem AI yang mendasarinya tersedia secara umum sehingga pengguna dapat mengunduh dan menjalankannya secara bebas di platform mereka sendiri, dan karenanya lebih murah untuk digunakan.

Kondisi tersebut menimbulkan tantangan ekonomi bagi perusahaan-perusahaan AI asal Amerika yang tetap menjadikan model mereka sebagai kepemilikan eksklusif, dan bertaruh bahwa pelanggan akan bersedia membayar guna mengakses produk AI dan membantu menyeimbangkan biaya jumbo untuk pusat data dan infrastruktur lainnya.

Baca Juga: OpenAI Kembali Tuding DeepSeek Menjiplak

Distilasi kali pertama mendapat perhatian signifikan pada Januari 2025, beberapa minggu setelah peluncuran DeepSeek atas model penalaran R1 yang menggemparkan dunia AI.

Tak lama setelahnya, Microsoft dan OpenAI menyelidiki apakah startup China tersebut telah secara tidak sah mengekstraksi sejumlah besar data dari model perusahaan AS tersebut untuk menciptakan R1, seperti yang dilaporkan Bloomberg sebelumnya.

Pada Februari, OpenAI memperingatkan anggota parlemen AS bahwa DeepSeek terus menggunakan taktik canggih untuk mengekstraksi hasil dari model AS, meskipun upaya pencegahan penyalahgunaan produknya telah ditingkatkan. OpenAI menyatakan dalam memo kepada Komite Khusus DPR AS tentang China bahwa DeepSeek mengandalkan distilasi untuk mengembangkan versi baru chatbot inovatifnya.

Distribusi informasi oleh perusahaan AI AS terkait distilasi adversarial sejalan dengan praktik standar di industri keamanan siber, di mana perusahaan-perusahaan secara rutin bertukar data mengenai serangan dan taktik para penyerang sebagai upaya untuk memperkuat pertahanan jaringan. Dengan bekerja sama, perusahaan-perusahaan AI tersebut juga berupaya mendeteksi praktik tersebut secara lebih efektif, mengidentifikasi pihak yang bertanggung jawab, serta mencegah pengguna yang tidak berwenang untuk berhasil.

Pejabat pemerintahan federal AS telah menunjukkan keterbukaan mereka untuk mendorong pertukaran informasi di antara perusahaan AI guna mengendalikan distilasi adversarial. Rencana Aksi AI yang diumumkan oleh Presiden Donald Trump tahun lalu menyerukan pembentukan pusat pertukaran dan analisis informasi, sebagian untuk tujuan ini.

Saat ini, pertukaran informasi mengenai distilasi masih terbatas karena ketidakpastian perusahaan AI mengenai apa yang dapat dibagikan berdasarkan panduan antimonopoli yang ada untuk menanggapi ancaman persaingan dari China, menurut sumber yang mengetahui masalah ini. Perusahaan-perusahaan tersebut akan diuntungkan oleh kejelasan yang lebih besar dari pemerintah AS, kata sumber-sumber tersebut.

Baca Juga: Segini Biaya Bangun AI China DeepSeek, Lebih Murah dari ChatGPT

Distilasi telah menjadi kekhawatiran utama di kalangan pengembang AI Amerika sejak DeepSeek mengguncang pasar global pada awal 2025 dengan rilis R1-nya. Model open-source yang sangat canggih terus berkembang di China, dan banyak pihak di industri ini memantau dengan cermat kemungkinan pembaruan besar pada model DeepSeek.

Tahun lalu, Anthropic melarang perusahaan-perusahaan yang dikendalikan oleh pihak China menggunakan model chatbot Claude miliknya, dan pada bulan Februari, perusahaan tersebut mengidentifikasi tiga laboratorium AI China— DeepSeek, Moonshot, dan MiniMax — secara ilegal mengekstraksi kemampuan model tersebut melalui proses distilasi.

Di 2026 Anthropic menyatakan bahwa ancaman tersebut “melampaui batas perusahaan atau wilayah mana pun” dan menimbulkan risiko keamanan nasional, karena model hasil distilasi sering kali tidak dilengkapi dengan pengaman yang dirancang untuk mencegah pelaku jahat menggunakan alat AI untuk kegiatan berbahaya.

Google dalam pernyataannya pada sebuah blog disebutkan bahwa mereka mengidentifikasi peningkatan upaya ekstraksi model. Ketiga laboratorium AI AS belum memberikan bukti yang menunjukkan seberapa besar inovasi model China bergantung pada distilasi, tetapi mereka mencatat bahwa prevalensi serangan dapat diukur berdasarkan volume permintaan data berskala besar.

(bbn)